Spring AI 可观测性完全指南:让AI应用监控变得简单高效

在AI应用爆发式增长的今天,Spring AI 1.0版本带来了革命性的可观测性功能。本文将深入探讨如何利用Spring AI + Micrometer 构建企业级AI应用监控体系,实现成本控制、性能优化和全链路追踪。

为什么Spring AI应用急需可观测性?

AI服务成本失控的痛点

在企业级AI应用中,使用DeepSeek、OpenAI、Google Gemini或Azure OpenAI等服务时,成本控制是一个严峻挑战:- Token消耗不透明:无法精确了解每次AI调用的成本

- 费用增长失控:大规模应用中,AI服务费用可能呈指数级增长

- 性能瓶颈难定位:AI调用链路复杂,问题排查困难

- 资源使用不合理:缺乏数据支撑的优化决策

Spring AI可观测性的价值

Spring AI的可观测性功能为这些痛点提供了完美解决方案:- ✅ 精准Token监控:实时追踪输入/输出Token消耗,精确到每次调用

- ✅ 智能成本控制:基于使用统计制定成本优化策略

- ✅ 深度性能分析:识别AI调用瓶颈,优化响应时间

- ✅ 完整链路追踪:端到端记录请求在Spring AI应用中的完整流转

实战演练:构建可观测的Spring AI翻译应用

第一步:Spring AI项目初始化

在start.spring.io创建Spring Boot项目,集成Spring AI核心依赖: Maven依赖配置(Spring AI BOM管理):第二步:Spring AI客户端配置

主应用类配置:第三步:构建Spring AI翻译服务

智能翻译控制器:第四步:Spring AI翻译API测试

Spring AI监控指标深度解析

核心指标1:Spring AI操作性能监控

指标端点:/actuator/metrics/spring.ai.chat.client.operation

- 监控Spring AI翻译服务调用频次

- 分析Spring AI响应时间分布

- 识别Spring AI性能瓶颈

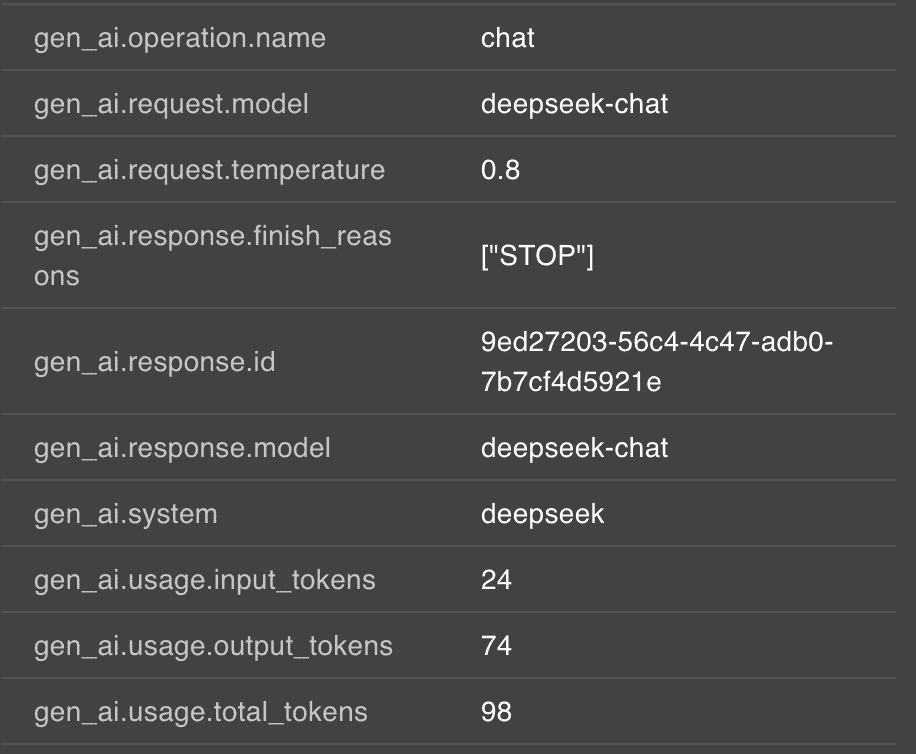

核心指标2:Spring AI Token使用量精准追踪

指标端点:/actuator/metrics/gen_ai.client.token.usage

- 精确计算Spring AI服务成本

- 优化Prompt设计降低Token消耗

- 制定基于使用量的预算策略

Spring AI调用链路追踪实战

第一步:集成Zipkin追踪

添加Spring AI追踪依赖:第二步:启动Zipkin服务

第三步:Spring AI追踪配置

Spring AI链路追踪效果展示

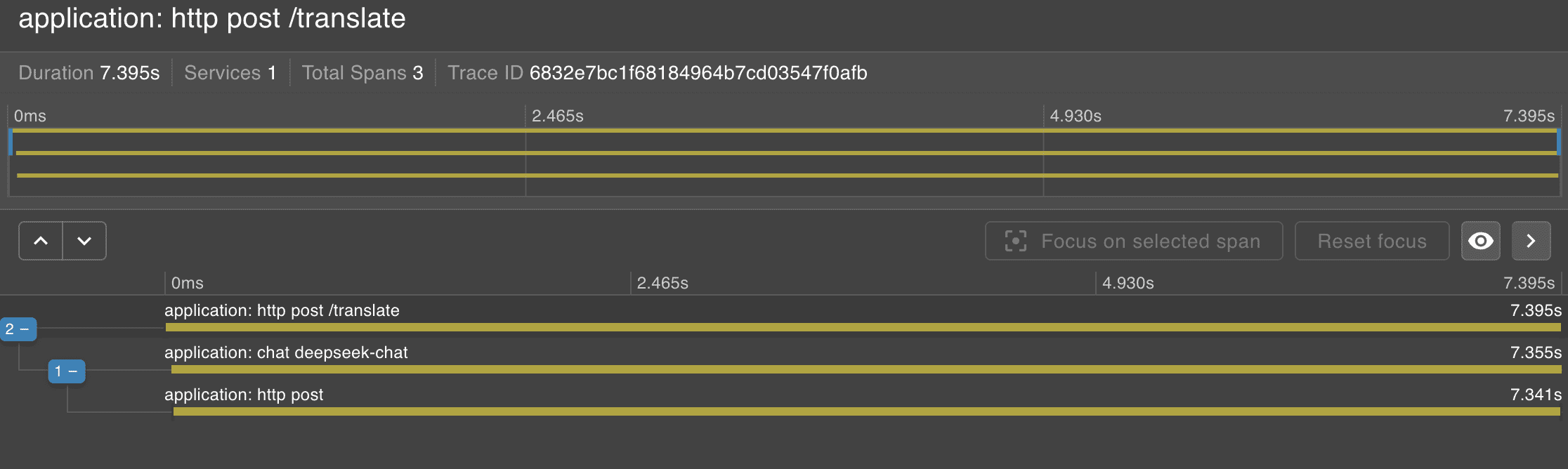

Zipkin界面展示Spring AI调用链路: Spring AI详细调用时序:

Spring AI详细调用时序:

通过Zipkin可以清晰看到:

通过Zipkin可以清晰看到:

- Spring AI ChatClient的调用耗时

- DeepSeek API的响应时间

- 完整的Spring AI请求链路

Spring AI Observations源码架构解析

Spring AI可观测性核心流程: Spring AI的可观测性基于以下核心组件:

Spring AI的可观测性基于以下核心组件:

- ChatClientObservationConvention:定义Spring AI观测约定

- ChatClientObservationContext:Spring AI观测上下文

- MicrometerObservationRegistry:指标注册中心

- TracingObservationHandler:链路追踪处理器